De politiek vroeg ons advies over AI in het onderwijs

D66 vroeg acht experts, waaronder David Maij, om advies over AI in het funderend onderwijs. In deze blog deelt hij de kern van dat gesprek: kansen, bedreigingen en beleidsaanbevelingen, onderbouwd met wetenschappelijk onderzoek.

Trainer / AI specialist

TLDR

D66 vroeg acht experts om input voor een initiatiefnota voor de tweede kamer. David (neuropsycholoog en oprichter van Onderwijs AI), werd gevraagd om mee te denken over de invloed van AI op het leren.

AI legt bestaande problemen in het onderwijs bloot. Leren en presteren zijn met elkaar verward geraakt, en AI versnelt die verwarring.

De kansen zijn groot (betere didactiek, werkdrukverlichting, kansengelijkheid), maar alleen als er pedagogisch wordt nagedacht over het ontwerp. De bedreigingen (cognitieve uitbesteding, toetsfraude, privacyrisico’s) vragen om een gecoördineerd antwoord.

De overheid zou suggesties mee kunnen nemen op het gebied van AI-beleid, toetsing en docentprofessionalisering, zonder de schoolautonomie te ondermijnen.

Aanleiding

Afgelopen maand werd ik uitgenodigd door een werkgroep van D66 die een initiatiefnota aan de Tweede Kamer voorbereidt over AI in het funderend onderwijs. Ze waren mij op het spoor gekomen via de podcast ‘Worden we dommer van AI?’, waar ik te gast was en inging op de effecten van AI op leren en (ongefundeerde) kritiek van Erik Scherder op AI. De werkgroep had al met zeven experts gesproken, waaronder Barend Last en Felienne Hermans, en vroeg mij specifiek naar de invalshoek van leren en gedragsverandering.

Dit interview heb ik voorbereid met Hans Visser, conrector op een middelbare school en betrokken bij Onderwijs AI, en Jasper Rooduijn, AI specialist en medeoprichter van Onderwijs AI. De werkgroep legde mij vier vragen voor:

Wat zijn de grootste kansen en bedreigingen van AI in het funderend onderwijs?

Wat moet er op centraal niveau geregeld worden?

Wat is nog meer relevant op landelijk niveau?

Zijn er belangrijke bronnen of voorbeelden van andere landen?

In deze blog deel ik de kern van dat gesprek, aangevuld met de wetenschappelijke onderbouwing uit mijn voorbereidingsdocument.

Het eigenlijke probleem: leren en presteren zijn verward geraakt

Voordat we het over AI hebben, moeten we het hebben over een probleem dat al langer speelt. Leren en presteren zijn met elkaar verward geraakt. We willen dat leerlingen en studenten kennis en vaardigheden aanleren die hen voorbereidt op het leven buiten de school, maar het systeem is ingericht op het presteren op schriftelijke toetsen binnen de schoolmuren. Dat draagt bij aan demotivatie en gedragsproblematiek, wat weer doorwerkt in het personeelstekort (Onderwijsraad, 2024).

AI legt dit probleem bloot. Generatieve AI is gespecialiseerd in het opleveren van schriftelijke producten. In een systeem dat die producten gebruikt als bewijs van leren, kan AI ze moeiteloos overnemen. De waarde zat echter nooit in het product, maar in het denkproces dat eraan voorafging. AI is voor mij een geschenk, omdat het het onderwijs dwingt om aan de slag te gaan met dit probleem.

Twee kaders om de invloed van AI op het onderwijs te begrijpen

Constructieve afstemming

In goed onderwijs is er sprake van constructieve afstemming: de leerdoelen, de leeractiviteiten en de toetsing zijn op elkaar afgestemd (Biggs & Tang, 2011). Wat je wilt dat leerlingen en studenten leren, bepaalt wat je in de les doet, en dat bepaalt hoe je toetst. AI is van invloed op alle drie die onderdelen. Wat moeten leerlingen en studenten nog leren in tijden van AI? Gaan we AI inzetten bij leeractiviteiten, en zo ja, onder welke voorwaarden? En hoe verzamelen we bewijs van leren als schriftelijke opdrachten buiten de klas met AI gemaakt kunnen worden (zie figuur 1)?

De driedeling van Haerlemans

Daarnaast kun je naar AI in het onderwijs kijken aan de hand van een driedeling (Haerlemans, 2024). Het onderwijs wordt momenteel verstoord door AI, bijvoorbeeld omdat huiswerkopdrachten eenvoudig gemaakt kunnen worden met AI zonder dat leerlingen en studenten er hard over nadenken. Dat maakt dat we moeten onderwijzen over AI. Hoe werkt AI eigenlijk? En onder welke omstandigheden is het (on)verstandig om dit te gebruiken? Ten slotte kun je met AI aan de slag gaan in je onderwijs. Bijvoorbeeld om je lesvoorbereidingen te versterken (zie figuur 2).

Met die twee kaders als bril kijken we nu naar de kansen en bedreigingen van AI in het onderwijs.

Kansen: waar AI het onderwijs kan versterken

Van producten naar denkprocessen

We denken in het onderwijs nog te veel dat we leren kunnen aflezen aan producten en toetsen. Leerlingen en studenten zetten zich vooral in voor prestaties, ervaren stress en verliezen motivatie. De toetsing is het doel geworden. AI legt dat probleem bloot, maar biedt ook een kans. Als het product duidelijk geen valide bewijs meer is van leren, kunnen we het gesprek voeren over wat dat bewijs dan wel is. De focus kan verschuiven naar het denkproces, naar hoe leerlingen en studenten tot begrip komen, en of ze dat begrip kunnen toepassen.

AI kan dat denkproces ondersteunen. Een AI-tutor die het begrip toetst via socratische vragen, is bezig met leren in plaats van met het opleveren van een product. Wat een docent doet in een goed onderwijsgesprek, kan AI aanvullend bieden, op elk moment, voor elke leerling individueel.

Een gerandomiseerd gecontroleerd onderzoek illustreert zowel de belofte als de beperking. Studenten die werkten met een zorgvuldig ontworpen AI-tutor presteerden beter in minder tijd dan studenten in een klassikale setting met actieve werkvormen (Kestin et al., 2025). De voorwaarde is dat de AI-tutor is gebouwd op bewezen pedagogische principes zoals aansluiten bij voorkennis, directe feedback en stapsgewijze begeleiding. Maar het gemeten effect is presteren, niet leren. Dat bevestigt precies het probleem: we hebben nog geen goede maat voor wat AI doet met het denkproces op de langere termijn. Het onderzoek naar AI in het funderend onderwijs is nog jong en bevat te weinig objectieve, langetermijn- of klassikale data (Alfarwan, 2025).

Als de focus verschuift van producten naar denkprocessen, moeten we ook nadenken over hoe we bewijs van leren gaan toetsen. Een mooi voorbeeld hiervan komt uit Duitsland (Npuls magazine, 2024) waar leerlingen de output van AI moesten gebruiken op een toets als startpunt. Daarbij moesten ze aangeven wat ze hadden overgenomen van AI, wat juist niet en waarom. Het denkproces daarbij werd beoordeeld.

Hogere verwachtingen, betere didactiek

Er zit een opvallende overlap tussen goed onderwijs en goed AI-gebruik. Je hebt leerdoelen nodig, begrip van voorkennis, succescriteria en duidelijke instructies. Dat zijn ook de vaardigheden die bepalen of je AI effectief kunt inzetten. Docenten die didactisch en pedagogisch sterk staan, hebben een voorsprong bij het inzetten van AI.

Omgekeerd kan AI docenten ondersteunen bij hun onderwijs. AI die je didactische literatuur meegeeft kan goed helpen bij leerdoelen, lesvoorbereidingen, werkvormen en toetsen. De verwachtingen over goed onderwijs mogen omhoog.

Dat geldt ook voor wat leerlingen en studenten leren. Niet alleen doordat docenten met betere didactiek en pedagogiek meer uit hun lessen halen, maar ook doordat leerlingen en studenten zelf AI kunnen inzetten. Voor studenten in het hoger onderwijs is dat al vrij vanzelfsprekend. Voor jongere leerlingen hangt het af van de mate waarin de school daarvoor de ruimte biedt en de begeleiding organiseert.

Evidence-based onderwijs wordt toegankelijker

Met deep research tools kunnen docenten snel een overzicht krijgen van wetenschappelijke literatuur over een bepaald thema. Daarmee wordt het eenvoudiger om de visie van een school, een werkvorm of een les te toetsen aan wat we weten over effectief leren. Dit is in lijn met de wens van de Onderwijsraad, die in ‘Leren van Onderzoek’ adviseert dat we breed moeten kijken naar wetenschappelijke onderbouwing.

Daar staat een risico tegenover. AI-systemen bevatten ook verouderde opvattingen over leren. Leermythes zoals leerstijlen en een simplistische toepassing van de taxonomie van Bloom leven voort in de output van AI-modellen (maar ook breed in onderwijsland). AI-geletterdheid kan dit probleem echter verminderen. Als je specifieke onderzoeken in tools als NotebookLM zet, verklein je de kans op hallucinaties aanzienlijk.

Werkdrukverlichting

Een onderzoek uit Engeland laat zien dat docenten die AI gebruikten voor lesvoorbereiding daar 31% minder tijd aan kwijt waren, terwijl de kwaliteit van hun lessen vergelijkbaar bleef (Roy et al., 2024). In een sector waar een groot gedeelte van de docenten werkdruk als barrière voor professionalisering noemt (OECD, 2025), is dat een relevant gegeven. Op korte termijn kan AI de werkdruk overigens juist verhogen, omdat docenten eerst moeten leren met de technologie te werken.

Kansengelijkheid

AI heeft de potentie in zich om onderwijs op maat te bieden aan elke leerling en kansengelijkheid te verkleinen. In het interview vergeleek ik het met mijn eigen situatie. Mijn vader was geschiedenisdocent, dus ik had een enorm voordeel bij geschiedenis. Hij kon me overhoren en de juiste vragen stellen. Een AI-tutor kan potentieel datzelfde doen voor leerlingen die thuis geen vakinhoudelijke begeleiding krijgen. Maar daar staat tegenover dat leerlingen met vaardige ouders en betaalde taalmodellen nu al een voorsprong opbouwen (CDE, 2023). Zonder een landelijk beschikbaar alternatief versterkt AI de bestaande ongelijkheid in plaats van die te verkleinen.

AI-geletterdheid als hefboom

AI-geletterdheid kan als hefboom werken op verschillende uitdagingen in het onderwijs. Scholen geven vaak aan dat docenten nog niet eens digitaal geletterd zijn, of dat er andere uitdagingen met meer prioriteit zijn, zoals basisvaardigheden of burgerschap. Zij missen het punt dat AI niet los hoeft te staan van die uitdagingen. In het interview gaf ik een voorbeeld over formatief handelen: een docent die worstelt met formatief handelen kan AI inzetten om sneller aan de hand van data de juiste vervolgstap te bepalen. Zo wordt AI-geletterdheid een versterker van wat de docent al doet. Ook wordt het eenvoudiger om digitale vaardigheden aan te leren, omdat je met AI voortdurend kunt laten zien waar je vastloopt en hoe je verder komt.

Hoe ver is jouw organisatie met de implementatie van AI-geletterdheid? Start nu de quick scan.

Bedreigingen: waar het mis kan gaan

Cognitieve uitbesteding: het kernrisico

Cognitieve offloading en cognitieve uitbesteding zijn twee verschillende dingen (Kirschner, 2026). Bij offloading gebruik je een extern hulpmiddel om tussenresultaten op te slaan, zodat je hoofd wordt vrijgemaakt om verder te denken. Wat leerlingen en studenten met AI doen is iets anders: ze geven het denken zelf uit handen. AI kiest wat relevant is, hoe ideeën worden opgebouwd, welke argumenten worden gemaakt. Dat is uitbesteding.

Het bewijs groeit. Leerlingen en studenten die onbeperkt toegang hadden tot GPT-4 presteerden significant slechter op een zelfstandig examen zonder AI-toegang (Bastani et al., 2025). Onbegeleid AI-gebruik kan ervoor zorgen dat informatie slechter wordt opgeslagen (Gerlich, 2025). Wanneer de AI-tutor was voorzien van pedagogische vangrails, verdwenen de negatieve effecten grotendeels (Fan et al., 2025). De negatieve effecten treden dus op bij onbegeleid gebruik; begeleid gebruik kan juist positief werken..

Niet alle toetsen zijn nog valide

Opdrachten en toetsen die buiten de klas of het toezicht worden gemaakt, lopen het risico dat ze met AI worden uitgevoerd. Het gaat specifiek om alles wat thuis kan worden gemaakt met de computer. Fraudedetectie werkt niet (Kennisnet, 2025). Ook docenten die AI nog niet actief inzetten worden hiermee geconfronteerd, omdat hun leerlingen het wel gebruiken.

Privacy kan worden geschonden

Sommige docenten voeren leerlinggegevens in bij AI-tools zonder dat er duidelijke afspraken zijn over dataverwerking. In onze trainingen komen er regelmatig docenten naar ons toe met de vraag of ze de AVG-richtlijnen hebben geschonden en dat is vaak het geval. Een groot probleem hierbij is dat op de meeste scholen de kaders en afspraken simpelweg ontbreken.

De ongelijkheid kan groeien

Leerlingen en studenten met veel voorkennis en vaardige ouders maken sneller stappen met AI. Leerlingen en studenten die achterlopen, raken verder achter (CDE, 2023).

Afhankelijkheid van commerciële systemen

Onderwijs is geen gewone afzetmarkt. Wanneer een klein aantal aanbieders de interfaces, standaarden en basisfuncties bepaalt, verschuift de macht over onderwijspraktijken ongemerkt mee. Zonder publieke infrastructuur en open standaarden wordt het onderwijs afhankelijk van commerciële partijen die publieke doelen niet vanzelfsprekend centraal stellen.

In het interview beschreef ik hoe de meeste scholen nu gebruikmaken van commerciële AI-modellen, met name vanwege bekendheid (ChatGPT) of bestaande licenties (Co-pilot). Die modellen zijn niet ontworpen voor onderwijs. De learning modes die ze aanbieden werken niet goed: als je doorvraagt om het antwoord, krijg je het gewoon. Daarbij is het ethisch kompas van OpenAI, maker van ChatGPT, ver te zoeken, maar toch is dit het meestgebruikte model.

Samenvattend

Risico’s en kansen zijn het gevolg van het ontwerp en de begeleiding. AI die het denkproces overneemt is schadelijk. AI die het denkproces begeleidt kan het versterken. Dat onderscheid maken vereist kennis van twee domeinen tegelijk: kennis van wat AI doet en kennis van hoe leren werkt.

Wat centraal geregeld zou kunnen worden

De volgende aanbevelingen kwamen voort uit de analyse van kansen en bedreigingen. Ik wil er eerlijk over zijn: een deel ervan raakt aan beleidsterreinen buiten mijn directe expertise. Ik heb dat in het gesprek ook benoemd, en ik begrijp dat bepaalde beleidsbeslissingen mogelijk ook weer negatieve gevolgen hebben. Ik breng ze in als suggesties waarover nagedacht kan worden door politici, niet als eisen. Maar ze volgen logisch uit wat het onderzoek naar leren en AI ons vertelt.

AI-beleid: afstemming van visie, structuur en cultuur

Elke school zou een AI-beleid moeten hebben. Ook een school die bewust weinig met AI wil doen, heeft ook een AI-beleid nodig, want ze moet nadenken over toetsing, over onderwijs over AI, en over wat haar leerlingen buiten school al doen. Kennisnet biedt hiervoor een stappenplan (Kennisnet, 2025), maar het is vrijblijvend. AI-beleid is meer dan een document: het gaat om de afstemming tussen visie (waar wil je als school naartoe met AI?), structuur (welke kaders en afspraken zijn er?) en cultuur (is er een professionele norm waarin experimenteren wordt aangemoedigd?). Zolang AI-beleid niet wordt verwacht, zullen besturen het niet op de agenda zetten. De onderwijsinspectie zou hierop kunnen toezien.

Hierbij is het wel wenselijk dat de overheid het goede voorbeeld geeft. Als we van scholen verwachten dat ze een AI-beleid ontwikkelen, dan moet de overheid dat ook hebben. AI komt nauwelijks voor in de eigen beleidsstukken en werkprocessen van de overheid.

Een Nederlandstalige, pedagogisch verantwoorde AI-leeromgeving

Leerlingen, studenten en docenten gebruiken AI al op grote schaal, meestal via commerciële tools zonder pedagogische inrichting. De overheid zou een Nederlandstalige AI-omgeving beschikbaar kunnen maken die het denkproces begeleidt in plaats van overneemt, op de manier waarop Estland dat doet met het AI Leap-programma (TI-Hüpe, 2025).

‘Pedagogisch verantwoord’ is geen neutraal begrip. Een school die werkt vanuit directe instructie stelt andere eisen dan een school die werkt vanuit zelfsturend leren. Een landelijk systeem zou daarom een gedeelde ondergrens moeten definiëren: AI die het denkproces overneemt is schadelijk, ongeacht je onderwijsvisie. Hoe het denken wordt gestimuleerd, kan variëren per school. Initiatieven als GPT-NL en EduGen AI zijn stappen in de goede richting.

Een landelijk kwaliteitskeurmerk voor educatieve AI-tools

Op dit moment kan elke leverancier een AI-tool aan scholen verkopen zonder onafhankelijke toetsing (OECD, 2025). In het interview vergeleek ik dit met het voedingskeurmerk, van A tot E. ChatGPT, een AI-modellen dat in het onderwijs voortdurend wordt gebruikt, krijgt wat mij betreft een E. Een keurmerk zou kunnen toetsen op de data en het model (op welke data is getraind, welke aannames over leren zitten erin), de procesinrichting (wat mag de AI doen en wat moet bij de leerling blijven), en validatie van de output (betrouwbaarheid, AVG- en AI Act-compliance, en pedagogische kwaliteit).

Suggesties voor toetsing

De discussie over toetsing bestond al vóór generatieve AI. AI veroorzaakt dat vraagstuk niet, maar maakt het onontkoombaar zichtbaar. Het College voor Toetsen en Examens (CvTE) en Stichting Leerplanontwikkeling (SLO) zouden van de overheid de opdracht kunnen krijgen om samen te werken aan nieuwe toetsvormen: meer procesevaluatie en toetsing van het denkproces.

AI-geletterdheid in lerarenopleidingen en nascholing

Docenten zijn grotendeels nog niet AI-geletterd. De randvoorwaarden ontbreken. Tegelijkertijd schrijft de AI Act voor dat professionals die AI gebruiken, geletterd moeten zijn in AI. Op dit moment worden die eisen door vrijwel geen enkele school gehaald. De overheid zou kunnen adviseren om AI-geletterdheid als onderdeel op te nemen in lerarenopleidingen en nascholing. Estland begint bewust met docenttraining vóórdat leerlingen toegang krijgen (TI-Hüpe, 2025). Finland biedt nationale materialen waarin wetgeving, AI-geletterdheid, privacy en didactiek samen worden aangeboden (Finnish National Agency for Education, 2025).

De ervaring leert dat AI-geletterdheid niet werkt als losstaand onderwerp. Docenten haken af wanneer het een extra verplichting is naast alles wat ze al moeten. Wat wél werkt: AI koppelen aan een uitdaging die de school al heeft. Een team dat worstelt met differentiatie onderzoekt hoe AI daarbij kan helpen. Een sectie die de werkdruk bij nakijken wil verlagen, experimenteert met AI-ondersteunde feedback. Zo wordt AI-geletterdheid iets wat past bij wat de docent al doet.

Wil jij jezelf of je collega's, in kleine en haalbare stappen, meer AI-geletterd maken? Wij bieden wetenschappelijk onderbouwde e-learnings en een didactisch verantwoorde aanpak om verantwoord met AI aan de slag te gaan.

Bekijk ons aanbodImplementatiebeleid voor de EU AI Act

Vanaf augustus 2026 gelden de high-risk verplichtingen van de AI Act. Scholen zijn ‘deployers’ en moeten voldoen aan eisen rond transparantie, menselijk toezicht en risicobeheer (Europese Commissie, 2024). De meeste scholen weten dit niet. De overheid zou een concreet implementatiekader kunnen ontwikkelen.

Wat verder relevant is op landelijk niveau

Onderzoeksfinanciering voor langetermijneffecten van AI op leerprocessen

Er is een tekort aan longitudinaal onderzoek naar de effecten van AI op leerprocessen. NOLAI doet waardevol werk, maar de bezuinigingen op het Nationaal Groeifonds bedreigen de continuïteit (OECD, 2025). Subsidies zouden specifiek gericht moeten zijn op langetermijneffecten. De kortetermijneffecten waar het onderzoeksveld mee wordt overspoeld zijn beperkt informatief. Dat je twee dagen na een interventie hoger scoort op een toets, zegt weinig over of het geleerde beklijft.

Er is al veel geprobeerd door individuele scholen en initiatieven, maar die ervaringen worden nauwelijks gebundeld. Het is wenselijk om onderzoek te financieren dat systematisch verzamelt wat er al is: wat werkt, wat niet, en onder welke voorwaarden.

Bescherming van kwetsbare groepen, leeftijdsgrens, curriculum en professionalisering

Leerlingen uit lagere sociaal-economische milieus lopen het grootste risico op een AI-kloof. Ze hebben thuis minder begeleiding en zijn afhankelijker van wat de school biedt (CDE, 2023). Kansengelijkheid, open standaarden, privacy en professionele ruimte moeten onderdeel zijn van AI-beleid.

SLO heeft in 2025 conceptkerndoelen voor digitale geletterdheid opgesteld, waarin AI een onderdeel is (SLO, 2025). De implementatie is nog niet geborgd. Voor leerlingen biedt het KIES-model een praktisch kompas (Mutsaarts, 2026): Kiezen, Instrueren, Evalueren, Spelregels. UNESCO adviseert een minimumleeftijd voor zelfstandig gebruik van generatieve AI-platforms (UNESCO, 2023). En professionalisering kost tijd, en tijd is wat docenten het minst hebben. Zonder beschermde uren blijft AI-geletterdheid een ambitie op papier.

Internationale voorbeelden

Estland is het eerste land dat AI systeembreed integreert in het onderwijs. Het programma TI-Hüpe is gestart met 20.000 leerlingen en 3.000 docenten en wordt in 2026 uitgebreid naar 38.000 extra leerlingen (TI-Hüpe, 2025). Het land begint bij docenttraining, koppelt implementatie aan een onderzoeksprogramma van de Universiteit van Tartu, en de AI-app geeft geen directe antwoorden maar werkt als coach.

De OECD-review (december 2025) constateert dat Nederland een sterk ecosysteem heeft (Kennisnet, SIVON, NOLAI) maar dat de sturing vanuit de overheid sterker moet: meer strategische coördinatie, betere kwaliteitscontrole op EdTech, en minder vrijblijvende professionalisering (OECD, 2025). UNESCO biedt de normatieve basis, Finland heeft wetgeving en praktijkondersteuning samengebracht in één nationaal kader, en Singapore verbindt AI aan een EdTech Masterplan 2030 (Singapore Ministry of Education, 2026).

Op de hoogte blijven?

Wil je vaker inhoudelijke blog artikelen lezen over veilige en verantwoorde toepassing van AI in het onderwijs. Meld je dan aan voor onze nieuwsbrief.

Wat doen wij met jouw gegevens? Lees onze voorwaarden.

Overzicht: kansen, bedreigingen en aanbevelingen

| Kans / Bedreiging | Aanbeveling | Internationaal voorbeeld |

|---|---|---|

| Kansen | ||

| Van producten naar denkprocessen | Landelijke regie op toetsing: CvTE en SLO werken aan nieuwe toetsvormen die het denkproces centraal stellen | Estland: AI Leap – AI-tutor als coach, geen directe antwoorden |

| Hogere verwachtingen, betere didactiek | Verplichte AI-geletterdheid in lerarenopleidingen en nascholing | Finland: nationaal kader met wetgeving, AI-geletterdheid, privacy en didactiek geïntegreerd |

| Evidence-based onderwijs wordt toegankelijker | Onderzoeksfinanciering gericht op langetermijneffecten en bundeling van praktijkervaring | OECD-review: Nederland moet sturing versterken en kwaliteitscontrole op EdTech verbeteren |

| Werkdrukverlichting | Tijd en ruimte voor professionalisering: beschermde uren oormerken | Estland: begint bij docenttraining vóórdat leerlingen AI gebruiken |

| Kansengelijkheid | Nederlandstalige AI-leeromgeving die pedagogisch verantwoord is ingericht | UNESCO: minimumleeftijd, dataprivacy, validatie op pedagogische geschiktheid |

| AI-geletterdheid als hefboom | AI-geletterdheid als onderdeel van het curriculum, niet als los keuzeonderwerp | Singapore: EdTech Masterplan 2030 |

| Bedreigingen | ||

| Cognitieve uitbesteding | Pedagogische vangrails in AI-tools; onderzoeksfinanciering voor langetermijneffecten; leeftijdsgrens voor onbegeleide AI-tools | Bastani et al. (2025): pedagogische vangrails heffen negatieve effecten op |

| Toetsen niet meer valide | Landelijke regie op toetsing: CvTE en SLO werken aan nieuwe toetsvormen | Kennisnet (2025): fraudedetectie werkt niet |

| Privacy kan worden geschonden | Implementatiebeleid voor de EU AI Act: concreet kader voor scholen | EU AI Act: high-risk classificatie voor educatieve AI vanaf augustus 2026 |

| De ongelijkheid kan groeien | Nederlandstalige AI-leeromgeving; bescherming van kwetsbare groepen | CDE (2023): ongelijkheid versterkt zonder landelijk alternatief |

| Afhankelijkheid van commerciële systemen | Kwaliteitskeurmerk voor educatieve AI-tools; publieke infrastructuur en open standaarden | OECD (2025): betere kwaliteitscontrole op EdTech nodig |

Tot slot

Alle kansen, bedreigingen en aanbevelingen in dit stuk komen terug op dezelfde twee vragen. De eerste is of leerdoelen, leeractiviteiten en toetsing nog op elkaar zijn afgestemd nu AI er is. De kansen liggen in het herstellen van die afstemming: minder nadruk op producten, meer op denkprocessen, betere didactiek, en toetsing die meet wat leerlingen daadwerkelijk leren. De bedreigingen ontstaan waar die afstemming ontbreekt: leerlingen die het denkwerk uitbesteden, toetsen die niet meer valide zijn, en ongelijkheid die groeit.

De tweede vraag is of we de verstoring voldoende begrijpen om AI verantwoord in te zetten. De driedeling van Haerlemans laat zien dat we nog midden in de verstoring zitten. De meeste scholen zijn bezig met reageren op wat AI doet met hun onderwijs. De stap naar onderwijs over AI en onderwijs met AI vraagt kennis, beleid en professionele ruimte die er op de meeste plekken nog niet is.

Individuele scholen kunnen deze problemen niet alleen en snel genoeg oplossen. De aanbevelingen in dit stuk zijn daarom gericht aan de politiek: zorg voor de randvoorwaarden, zodat scholen het goed kunnen doen.

Bronnen

Alfarwan, S. (2025). Generative AI use in K-12 education: a systematic review. Frontiers in Education.

Bastani, H., Bastani, O., Sungu, A., Ge, H., Kabakcı, Ö., & Mariman, R. (2025). Generative AI without guardrails can harm learning: Evidence from high school mathematics. Proceedings of the National Academy of Sciences.

Biggs, J., & Tang, C. (2011). Teaching for quality learning at university (4e druk). Open University Press.

CDE. (2023). 2023 AI Guidance – Professional Learning. California Department of Education.

Dietz, G., Outa, J., Lowe, L., Landay, J. A., & Gweon, H. (2023). Theory of AI Mind: How adults and children reason about the ‘mental states’ of conversational AI. Proceedings of the Annual Meeting of the Cognitive Science Society.

Europese Commissie. (2024). Regulation (EU) 2024/1689 laying down harmonised rules on artificial intelligence (AI Act). Official Journal of the European Union.

Fan, Y., Tang, L., Le, H., et al. (2025). Beware of metacognitive laziness: Effects of generative artificial intelligence on learning motivation, processes, and performance. British Journal of Educational Technology.

Finnish National Agency for Education. (2025). Artificial intelligence in education – legislation and recommendations.

Gerlich, M. (2025). ChatGPT as a cognitive crutch: Evidence from a randomized controlled trial on knowledge retention. International Journal of Information Management.

Haerlemans, C. (2024, 28 februari). Technologische ontwikkeling in het onderwijs [Keynote presentatie]. IPON 2024, Utrecht.

Kennisnet. (2025). Handreiking AI in het onderwijs.

Kestin, G., et al. (2025). AI tutoring outperforms in-class active learning: An RCT introducing a novel research-based design. Scientific Reports.

Kirschner, P. A. (2026, 13 januari). Cognitieve offloading vs. outsourcing: Wat is het verschil? [Blogpost].

Mutsaarts, M. (2026, 14 maart). Verscheurd door AI [LinkedIn-post].

OECD. (2025). OECD Review of Digital Education Policy in the Netherlands. OECD Reviews of School Resources.

Onderwijsraad. (2024). Grensatisfactie: de waarde van brede vorming in het voortgezet onderwijs. Den Haag.

Onderwijsraad. (2026, 19 maart). Leren van onderzoek [Advies]. Den Haag.

Roy, P., Poet, H., Staunton, R., Aston, K., & Thomas, D. (2024). ChatGPT in Lesson Preparation: A Teacher Choices Trial. Education Endowment Foundation.

Singapore Ministry of Education. (2026). Artificial intelligence in education.

SLO. (2025). Conceptkerndoelen digitale geletterdheid.

TI-Hüpe. (2025). AI Leap Estonia.

UNESCO. (2023). Guidance for generative AI in education and research. UNESCO Publishing.

Verantwoording gebruik AI tools

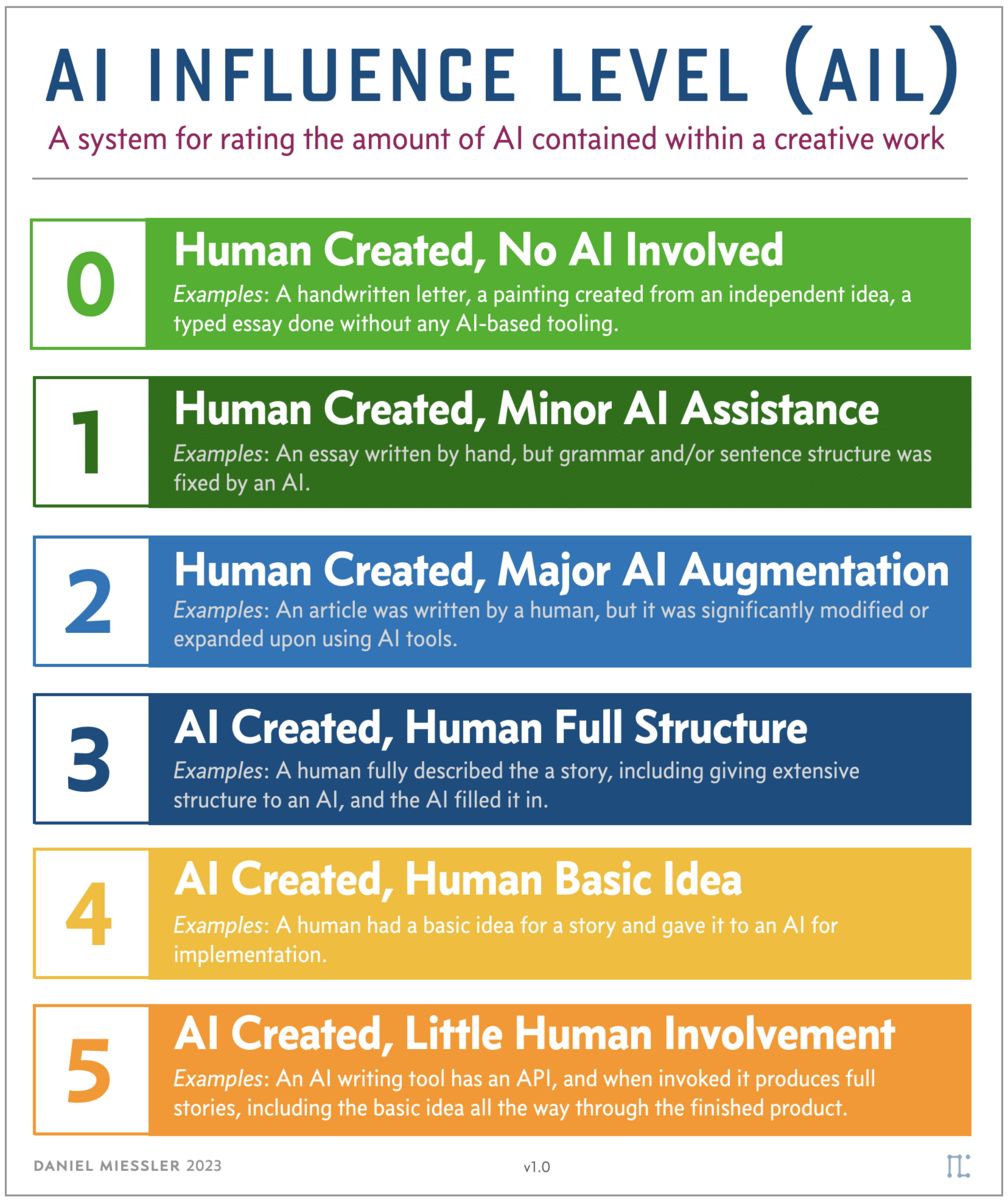

Het 'AI influence level' van dit artikel is 2:

- Bij het schrijven van deze blog is gebruik gemaakt van Claude (Anthropic) voor het structureren van bronnen en het genereren van een eerste concept

- De inhoud is gebaseerd op een voorbereidingsdocument voor het interview en een transcriptie van het gesprek met de D66-werkgroep. De transcriptie is gemaakt met behulp van Wispr.